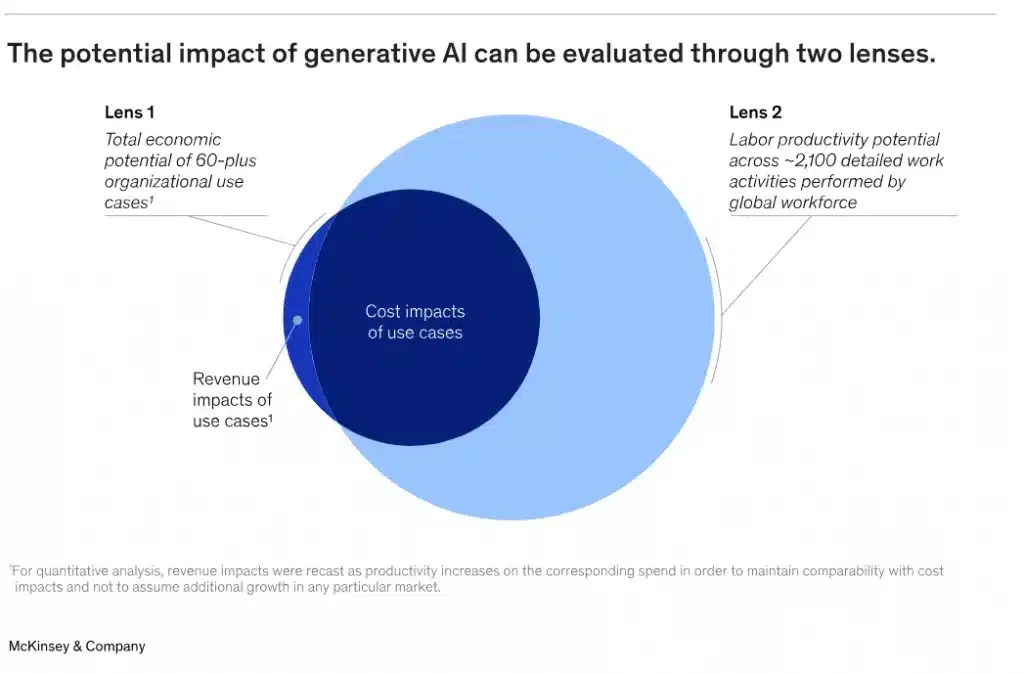

Secondo il report McKinsey "The Economic Potential of Generative AI", il potenziale economico dell'AI generativa si conferma tra i 2,6 e i 4,4 trilioni di dollari annui, equivalenti a circa il 4 – 8 % del PIL mondiale.

Rispetto alle stime precedenti, l'impatto globale dell'AI sull'economia sta crescendo del 15–40 %, grazie all'integrazione della gen‑AI nei software usati quotidianamente.

Indice

- L'impatto dell'AI generativa

- Esempi di impatto previsti

- Rischi e limiti dell'AI generativa

- L'importanza del controllo

- Come implementare l'AI generativa senza rischi

- Conclusioni

L'impatto dell'AI generativa {#limpatto-dellai-generativa}

Secondo McKinsey, lo sviluppo dell'AI generativa avrebbe un significativo impatto sulla produzione di diversi settori industriali (tra cui banche, high tech, biotecnologie) e contribuirebbe ad aumentare la produttività del lavoro, parzialmente compensando la diminuzione dell'occupazione e contribuendo alla crescita economica.

In particolare, saranno 4 funzioni aziendali a beneficiare dell'incremento in termini di produttività, favorito dall'automazione: Customer Operations, Marketing e Vendite, Software Engineering e Ricerca e Sviluppo.

In ambito Customer Operations, ad esempio, l'AI generativa potrebbe ridurre del 50% la presa in carico delle richieste di assistenza a carico degli agenti, mentre in ambito Sales e Marketing, il contributo dell'AI generativa nella creazione di contenuti contribuirebbe ad aumentare la produttività tra il 5 e il 15%.

Nel campo del Software Engineering, l'ausilio della Generative AI nelle attività di sviluppo, correzione e re-factoring del codice aumenterebbe la produttività tra il 20% e il 45%.

Esempi di impatto previsti {#esempi-di-impatto-previsti}

- Customer operations – automazione fino al 50 % delle interazioni, già oggi automatizzate in molte banche, telecom e utility

- Marketing & Vendite – aumento della produttività tra il 5 % e 15 %, con un +3–5 % focalizzato sulle vendite globali

- Software Engineering – boost tra il 20 % e il 45 % grazie a generazione, refactoring e debugging del codice mediati da AI

- R&D – ottimizzazioni nella progettazione e selezione dei materiali, così come nella produzione, con un impatto indiretto sui costi

Nel complesso, McKinsey stima che la produttività del lavoro possa crescere tra lo 0,1 % e 0,6 % all'anno fino al 2040, e con l'effetto cumulativo di tutte le tecnologie l'incremento produttivo potrebbe arrivare a 0,5 – 3,4 punti percentuali annui.

Rischi e limiti dell'AI generativa {#rischi-e-limiti-dellai-generativa}

La ricerca IDC "Generative AI in EMEA: Opportunities, Risks, and Futures" identifica tre aspetti principali dell'IA generativa in cui si concentrano sfide e rischi: le capacità intrinseche (e i limiti) dei sistemi, i processi con cui vengono creati e i modi in cui sono potenzialmente utilizzati.

Ad esempio, in termini di "Capabilities" vengono identificati i rischi legati alle "allucinazioni" dei sistemi di AI, bias e produzione di contenuti generici, mentre in termini di utilizzo è evidenziata l'esposizione al rischio di plagio, di disinformazione, frode e comportamenti non pianificati.

L'importanza del controllo {#limportanza-del-controllo}

L'AI basata su modelli linguistici di grandi dimensioni "sa come parlare, ma non sa cosa dice".

In gergo tecnico si parla di "allucinazioni", quando l'AI restituisce un'informazione distorta o completamente inventata, nel momento in cui non riesce a trovare risposte.

Per questo è importante mantenere il controllo umano non solo in fase di addestramento dei modelli, ma anche di verifica dell'output generato.

Tra i principali limiti dei LLM troviamo:

- Il rischio di bias: i modelli sono addestrati su ampi dataset di testo che possono contenere distorsioni o pregiudizi, generando talvolta risposte involontariamente discriminatorie.

- La conoscenza limitata: sebbene i modelli abbiano accesso a una grande quantità di informazioni, non sono in grado di accedere a tutta la conoscenza umana. Potrebbero non rispondere su argomenti di nicchia o non essere aggiornati su recenti sviluppi.

Diffidenza dei consumatori

Un report Gartner (giugno 2025) evidenzia che il 60 % dei consumatori non si fida della gen-AI, preoccupati da problemi di accuratezza, contesto e trasparenza. Solo il 40 % la ritiene affidabile.

Quali precauzioni adottare?

Secondo Gartner è indispensabile che le organizzazioni adottino le seguenti "best practice":

- Assicurarsi che le persone siano consapevoli di interagire con una macchina, etichettando chiaramente l'intera conversazione.

- Attivare strumenti di "due diligence" e controllo della tecnologia per tenere traccia di bias incontrollati e altri problemi di affidabilità nell'uso di LLM.

- Proteggere privacy e sicurezza assicurandosi che i dati sensibili non siano oggetto di prompting né siano derivati dall'utilizzo di LLM.

Come implementare l'AI generativa senza rischi {#come-implementare-lai-generativa-senza-rischi}

- Definisci gli obiettivi e i limiti — Prima di tutto, chiarisci dove e perché vuoi usare l'AI generativa: customer service, marketing, HR, sviluppo prodotto?

- Scegli modelli affidabili e tracciabili — Opta per provider che garantiscano trasparenza, documentazione chiara, tracciabilità delle fonti e funzionalità di auditing.

- Applica la logica del "human-in-the-loop" — L'AI non deve sostituire, ma affiancare l'intelligenza umana. Prevedi sempre un controllo umano sulle decisioni critiche.

- Integra strumenti di governance e monitoraggio — Implementa dashboard e metriche per monitorare l'accuratezza, l'efficienza, l'uso dei dati e l'eventuale presenza di bias.

- Forma il team e comunica con trasparenza — Investi nella formazione interna e sii trasparente con clienti e stakeholder: dichiara sempre quando un contenuto è stato generato dall'AI.

Conclusioni {#conclusioni}

L'AI generativa rappresenta una rivoluzione tecnologica e produttiva, ma richiede una forte spinta verso responsabilità, trasparenza e governance. Solo un approccio strutturato – che includa fiducia del consumatore, adeguata supervisione e protezione dei dati – potrà trasformare il potenziale in valore reale e sostenibile.

FAQ

Cos'è l'AI generativa e in cosa si differenzia dalle altre forme di intelligenza artificiale? L'AI generativa è una branca dell'intelligenza artificiale che crea contenuti nuovi, come testi, immagini, audio, codice o video, partendo da input testuali o altri dati. A differenza dell'AI tradizionale, che si limita ad analizzare dati o fare previsioni, l'AI generativa produce output originali, simulando la creatività umana.

Come funziona un modello di AI generativa come ChatGPT? Modelli come ChatGPT sono addestrati su vasti volumi di testi per imparare strutture linguistiche, significati e contesti. Quando ricevi un prompt, l'AI calcola la probabilità statistica delle parole che possono seguire, generando risposte coerenti e contestualmente appropriate.

L'AI generativa è davvero intelligente? Dipende da cosa intendiamo per "intelligenza". L'AI generativa non ha consapevolezza, emozioni o intenzioni. È molto brava a imitare il linguaggio e a rispondere a input complessi, ma non ha coscienza né comprende il mondo come un essere umano. È uno strumento potente, utile se usato con criterio, ma ha bisogno di supervisione e contesto umano per essere affidabile.